DeepSeek prokázal, že trénink AI nevyžaduje nejdražší GPU jako H100. Místo toho mohou firmy dosáhnout vysokého výkonu s nižšími náklady díky repasovaným GPU NVIDIA A100, V100 nebo H800.

Nákladově efektivní AI s GPU NVIDIA A100 a V100

Umělá inteligence se vyvíjí rychlým tempem a firmy po celém světě hledají způsoby, jak vybudovat AI infrastrukturu bez nadměrných výdajů. Úspěch společnosti DeepSeek, čínské AI firmy, ukázal, že špičková AI nevyžaduje nejnovější nebo nejdražší GPU – jde o správný výběr hardwaru.

Například ChatGPT byl trénován pomocí GPU NVIDIA V100 a A100, zatímco DeepSeek použil přibližně 2 000 GPU NVIDIA H800 – modelu navrženého pro Čínu s omezenou propustností mezi čipy ve srovnání s jeho globálním protějškem H100.

Ačkoli A100 a V100 patří do předchozí generace, zůstávají vysoce schopnými pro trénink AI i inferenci. To poukazuje na zásadní změnu – firmy mohou dosáhnout silného výkonu AI s nákladově efektivními možnostmi, jako jsou A100 a V100, namísto investování do nejnovějších a nejdražších GPU.

Co je DeepSeek?

DeepSeek je čínská AI společnost, která si získala celosvětovou pozornost díky vývoji AI modelu, který by mohl konkurovat OpenAI ChatGPT – ale za podstatně nižší náklady. Na rozdíl od amerických AI gigantů, kteří investují miliardy do infrastruktury, DeepSeek tvrdí, že svůj AI model vytrénoval pouze na 2 000 GPU NVIDIA H800, což dokazuje, že špičková AI nevyžaduje nejdražší hardware.

Tento přístup řadí DeepSeek mezi cenově efektivní alternativy v oblasti AI vývoje a zpochybňuje průmyslový standard, že špičková AI vyžaduje obrovské finanční investice.

Kdo vlastní DeepSeek?

DeepSeek byl spuštěn v červenci 2023 Liangem Wenfengem, absolventem univerzity Zhejiang, který se specializuje na AI řízené investiční strategie. Jeho hedgeový fond High-Flyer poskytl finanční podporu a prostřednictvím dvou zastřešujících společností vlastní 84 % podílu ve firmě.

Vznik DeepSeek představuje změnu v oblasti AI vývoje a ukazuje, že AI modely lze efektivně trénovat i bez miliardových investic do infrastruktury, což může zásadně změnit způsob, jakým firmy investují do AI.

Budování AI serverů s nižšími náklady s repasovanými GPU NVIDIA A100

S rostoucím přijetím AI firmy přehodnocují své strategie ohledně hardwaru. Místo utrácení milionů za nejnovější GPU volí mnoho podniků repasované GPU NVIDIA A100, které jim umožňují škálovat AI infrastrukturu za zlomek nákladů.

Mimo Čínu je A100 nejlepší alternativou k H800, protože nabízí podobný výkon pro trénink AI s lepší celosvětovou dostupností. Zatímco V100 zůstává solidní volbou pro inferenci, A100 přináší lepší efektivitu, škálovatelnost a vyšší propustnost paměti pro moderní AI aplikace.

H100 je nejvýkonnější volbou, ale A100 poskytuje nejlepší poměr cena/výkon pro podniky, které optimalizují své AI investice.

Proč zvolit repasované GPU A100?

✔ Úspory až 70 % – Podnikový AI výkon za nižší náklady

✔ Udržitelné a efektivní – Prodloužení životnosti GPU a snížení IT nákladů

✔ Optimalizováno pro AI – Ideální pro deep learning a rozsáhlé jazykové modely (LLM)

Nižší náklady, maximální výkon

Vysoké náklady na nový hardware omezují přijetí AI, ale repasované GPU A100 poskytují obrovský výpočetní výkon pro deep learning, trénink modelů a real-time AI aplikace – což pomáhá podnikům udržet konkurenceschopnost.

Kromě úspor repasované GPU uvolňují kapitál pro AI výzkum, optimalizaci dat a vývoj softwaru – urychlují inovace a zároveň zachovávají finanční flexibilitu.

NVIDIA H100 je zdaleka nejvýkonnější GPU pro AI pracovní zátěže, ale přichází s výrazně vyšší cenou. A100 na druhé straně nabízí nejlepší poměr cena/výkon, což z něj činí ideální volbu pro podniky, které potřebují vysokorychlostní trénink AI bez nákladů na upgrade na H100.

Jak si NVIDIA A100 stojí ve srovnání s H800?

H800 je varianta H100 určená specificky pro Čínu, která byla vyvinuta s nižší šířkou pásma NVLink a celkově nižším výkonem kvůli exportním omezením ze strany USA. Ačkoli H800 nabízí silné AI schopnosti, podniky mimo Čínu k ní nemají přístup a potřebují alternativu.

Pro podniky mimo Čínu je nejlepší alternativou k H800 model A100, který poskytuje vysoký výkon a efektivitu pro AI pracovní zátěže. Nicméně H100 zůstává nejlepší volbou pro ty, kteří vyžadují nejvyšší úroveň výpočetního výkonu pro AI.

| Specifikace | NVIDIA H100 | NVIDIA H800 | NVIDIA A100 |

|---|---|---|---|

| Architektura | Hopper | Hopper | Ampere |

| Výrobní proces | 4nm TSMC | 4nm TSMC | 7nm TSMC |

| GPU paměť | 80GB HBM3 | 80GB HBM3 | 40GB/80GB HBM2e |

| Šířka pásma paměti | Až 3,35 TB/s (SXM) | ~1.9 TB/s (SXM) | Až 2,0 TB/s (verze 80GB) |

| Šířka pásma NVLink | 900 GB/s | 400 GB/s | 600 GB/s |

| Generace PCIe | PCIe 5.0 | PCIe 4.0 | PCIe 4.0 |

| Výkon | Nejvyšší výkon pro trénink AI a inferenci | Snížený výkon kvůli nižší šířce pásma NVLink | Silný výkon pro trénink AI a HPC |

| Dostupnost na trhu | Globální (Enterprise AI, HPC) | Omezeno na Čínu | Globální |

| Nejlepší využití | Velké AI modely, trénink LLM, vysokovýkonná AI | Nákladově efektivní AI pro čínské podniky | Trénink AI, deep learning, HPC úlohy |

Ušetřete až 70 % při nákupu repasované grafické karty NVIDIA A100 od Renewtech

Grafická karta NVIDIA A100 Tensor Core je navržena pro trénink AI, hluboké učení a inferenci. Nabízí vysokou šířku pásma pro náročné AI úlohy za zlomek ceny novějších modelů.

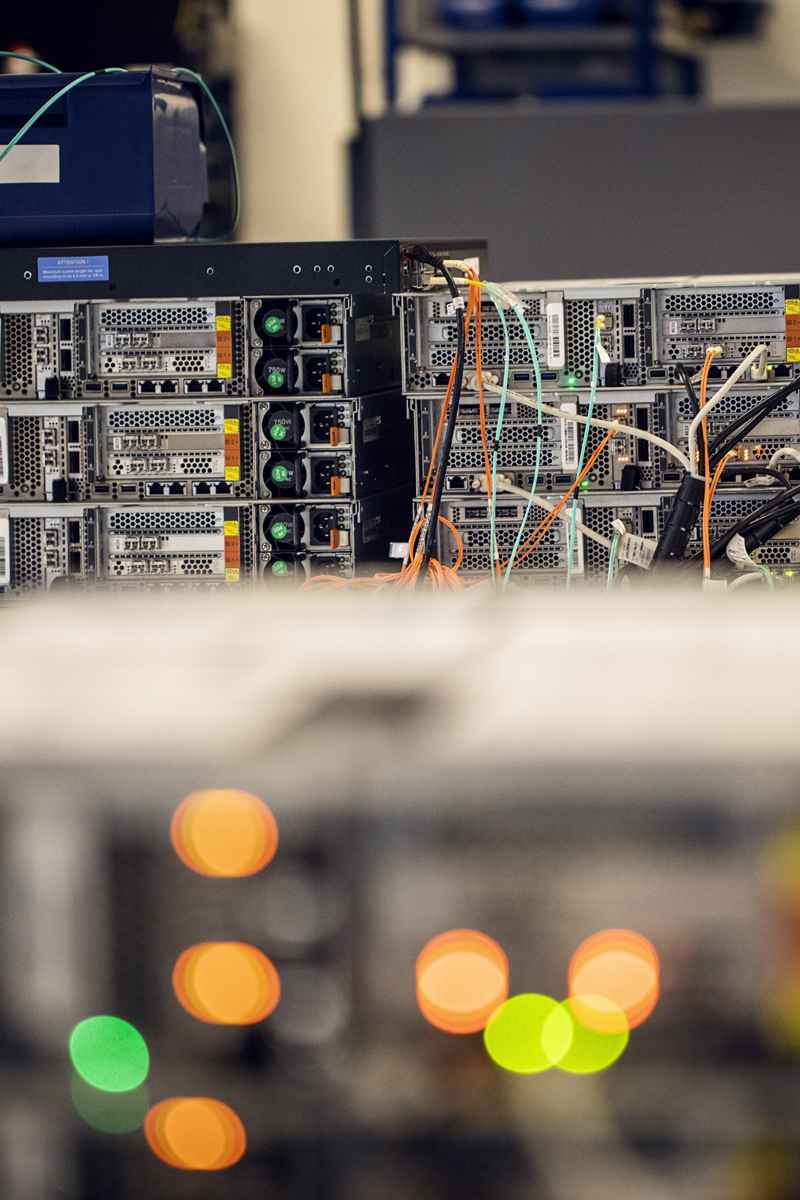

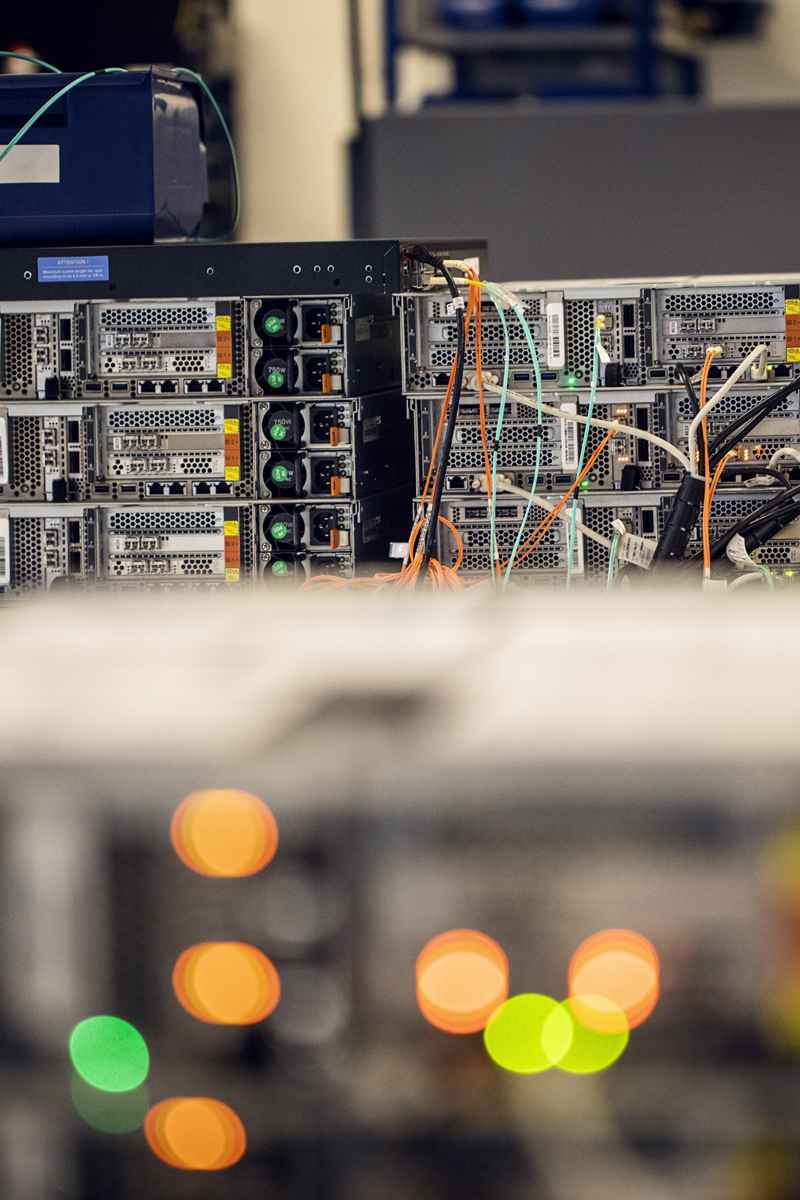

AI servery, které podporují NVIDIA A100

Výběr správného AI serveru je klíčový pro škálovatelnost, efektivitu a nákladovou efektivitu. AI úlohy – jako je hluboké učení, velké jazykové modely (LLM) a real-time inference – vyžadují výkonný hardware pro maximální výkon bez zbytečných nákladů.

Pro podniky, které chtějí rozšířit AI s minimálními výdaji, repasované grafické karty NVIDIA A100 poskytují vysoký výpočetní výkon za zlomek ceny. Abychom usnadnili rozhodování, vybrali jsme dva vysoce výkonné AI servery, které plně podporují NVIDIA A100 a nabízejí ideální rovnováhu mezi rychlostí, spolehlivostí a cenovou efektivitou.

Proč záleží na výběru správného AI serveru

- Optimalizované pracovní zátěže – trénink AI, inference a hluboké učení vyžadují výkonné GPU, paměť a šířku pásma PCIe pro plynulý chod.

- Škálovatelnost a budoucí rozšíření – dobře zvolený server zajistí hladkou expanzi, jak rostou nároky na AI.

- Nákladová efektivita – investice do správného hardwaru maximalizuje návratnost investic a minimalizuje zbytečné výdaje.

Díky serverům s NVIDIA A100 mohou podniky vybudovat AI infrastrukturu, která poskytuje vysoký výkon a zároveň zůstává v rámci rozpočtu.

Supermicro SYS-4028GR-TRT vs. Dell PowerEdge R740 pro AI

Výběr správného AI serveru je klíčový pro dosažení maximálního výkonu a efektivity. Jak Supermicro SYS-4028GR-TRT, tak Dell PowerEdge R740 podporují grafické karty NVIDIA A100, ale jsou optimalizovány pro různé AI pracovní zátěže.

- Supermicro SYS-4028GR-TRT je navržen pro škálovatelné hluboké učení a podporuje až 4 grafické karty NVIDIA A100, což z něj činí ideální volbu pro firmy, které potřebují vysokou hustotu GPU.

- Dell PowerEdge R740 naproti tomu podporuje až 2 grafické karty A100, což z něj dělá nákladově efektivní alternativu pro podniky zaměřené na inference a menší tréninkové úlohy.

Níže uvádíme srovnání obou serverů, které vám pomůže rozhodnout se, který AI server nejlépe vyhovuje vaší GPU infrastruktuře.

| Funkce | Supermicro SYS-4028GR-TRT | Dell PowerEdge R740 |

| Podpora GPU | Až 4x NVIDIA A100 PCIe – optimalizováno pro více-GPU AI pracovní zátěže. | Až 2x NVIDIA A100 PCIe – navrženo pro AI akceleraci s ohledem na náklady. |

| Možnosti CPU | Intel Xeon Scalable (2. generace) – dvousocketová podpora pro vysoký AI výkon. | Intel Xeon Scalable (2. generace) – dobře vyvážený pro inference úlohy. |

| Kapacita paměti | Až 6TB DDR4 – vytvořeno pro rozsáhlé AI modely a hluboké učení. | Až 3TB DDR4 – podporuje AI pracovní zátěže, ale s nižší škálovatelností. |

| Možnosti úložiště | Podporuje až 24x 2,5” disků (HDD/SSD) – navrženo pro datově náročný AI trénink. | Podporuje až 16x 2,5” disků (HDD/SSD) – dostačující pro inference aplikace. |

| Síť a konektivita | Více možností 10GbE a 25GbE, PCIe 4.0 pro vysokorychlostní AI přenos dat. | Dvojice 10GbE portů, PCIe 4.0, vhodné pro efektivní AI inference. |

| Rozšiřitelnost a škálovatelnost | Více PCIe Gen 4 slotů – ideální pro konfigurace s více GPU a budoucí rozšíření. | Silná podpora PCIe 4.0 – vhodné pro AI úlohy, ale omezená možnost škálování více GPU. |

| Chlazení a napájení | Optimalizováno pro vysokou hustotu GPU – pokročilé chlazení pro efektivní řízení teploty více GPU A100. | Efektivní řízení teploty – energeticky účinné chlazení pro inference pracovní zátěže. |

| Formát a hustota | 4U rackový server – vyšší hustota, navržen pro trénink AI modelů ve velkém měřítku. | 2U rackový server – prostorově efektivní s mírnou AI akcelerací. |

| Hlavní použití | Trénink AI modelů, hluboké učení a LLM – ideální pro AI výzkum a produkci. | AI inference, nákladově efektivní AI nasazení – optimalizováno pro podniky, které škálují AI s ohledem na náklady. |

Supermicro SYS-4028GR-TRT

Vysoce výkonný AI server s vysokou hustotou, určený pro výpočty s více GPU, Supermicro SYS-4028GR-TRT je navržen tak, aby maximalizoval výkon NVIDIA A100. Díky dostatečnému počtu PCIe 4.0 linek, vysoké energetické účinnosti a špičkovému chlazení zajišťuje stabilní trénink a inferenci AI modelů.

- Optimalizováno pro AI a strojové učení – podporuje konfigurace s více GPU, což jej činí ideálním pro hluboké učení a rozsáhlé AI modely.

- Výkonnost na podnikové úrovni – vysoká šířka pásma a účinné chlazení umožňují zpracování náročných AI výpočtů.

Odemykejte výkon AI se Supermicro SYS-4028GR-TRT

Dell PowerEdge R740

Univerzální podnikový server Dell PowerEdge R740 nabízí škálovatelné řešení pro AI a HPC úlohy. Podporuje více GPU NVIDIA A100, poskytuje vysokou kapacitu paměti, efektivní chlazení a silný výkon PCIe 4.0.

- Škálovatelná AI infrastruktura – konfigurovatelný pro trénink AI modelů, inferenci a výkonné výpočty.

- Nákladově efektivní výkon – repasovaný R740 umožňuje podnikům integrovat AI bez nadměrných výdajů, přičemž zachovává vysoký výkon.

Odemykejte výkon AI s PowerEdge R740

Maximalizace výkonu AI s H100 servery

Pro podniky, které vyžadují větší výpočetní výkon pro špičkové AI aplikace, upgrade na NVIDIA H100 GPU nabízí jednu z nejvyšších úrovní AI výkonu dostupných na trhu. Ať už pracujete na rozsáhlém hlubokém učení, tréninku LLM nebo real-time inferenci, správná serverová infrastruktura je klíčová.

Na rozdíl od předchozích generací GPU poskytují H100:

- Bezkonkurenční AI akceleraci – rychlejší operace s maticemi, zvýšenou šířku pásma NVLink a vyšší efektivitu paměti.

- Škálovatelnost budoucnosti – optimalizováno pro trénink AI, HPC a podnikové úlohy s podporou PCIe 5.0.

Firmy pracující s rozsáhlými AI datovými sadami, simulacemi nebo pokročilým laděním modelů získají největší přínos z nasazení serverů připravených na H100. Tyto servery jsou navrženy pro zpracování náročných AI úloh s vysokou šířkou pásma, což zajišťuje rychlejší tréninkové časy, real-time inferenci a plynulou škálovatelnost pro budoucí AI projekty.

Díky repasovaným AI serverům mohou podniky integrovat H100 GPU za nižší náklady a vyhnout se zbytečným výdajům na infrastrukturu, přičemž stále těží z prvotřídního AI výkonu.

Níže jsme vybrali dva vysoce výkonné AI servery, které plně podporují NVIDIA H100 GPU, což podnikům umožňuje získat potřebný výkon bez nadměrných výdajů.

Dell R750 vs. Lenovo SR650 V2 pro AI

Výběr správného serveru pro AI a hluboké učení je zásadní pro maximalizaci výkonu a efektivity. Dell PowerEdge R750 a Lenovo ThinkSystem SR650 V2 podporují NVIDIA H100 GPU, ale každý je optimalizován pro mírně odlišné potřeby. R750 nabízí více PCIe slotů pro lepší rozšiřitelnost, zatímco SR650 V2 se zaměřuje na škálovatelnost a nákladovou efektivitu. Níže uvádíme srovnání obou serverů, které vám pomůže rozhodnout, který lépe vyhovuje vaší AI infrastruktuře.

| Funkce | Dell PowerEdge R750 | Lenovo ThinkSystem SR650 V2 |

| Podpora GPU | Až 2x NVIDIA H100 PCIe | Až 2x NVIDIA H100 PCIe |

| Možnosti CPU | Intel Xeon Scalable (3. generace) | Intel Xeon Scalable (3. generace) |

| Kapacita paměti | Podporuje až 8TB DDR4/DDR5 | Podporuje až 8TB DDR4/DDR5 |

| Možnosti úložiště | Podporuje až 28x 2,5” disků (HDD/SSD) | Podporuje až 20x 2,5” disků (HDD/SSD) |

| Síť a konektivita | Dvojice 10GbE portů, PCIe Gen 5 sloty pro budoucí rozšíření | Dvojice 10GbE portů, PCIe Gen 4, vysoká energetická účinnost |

| Rozšiřitelnost a škálovatelnost | Více PCIe Gen 4/5 slotů – ideální pro konfigurace s více GPU a AI akcelerátory jako NVIDIA NVLink Bridges | Energeticky úsporný design s chlazením Lenovo Neptune – zaměřeno na úsporu nákladů při zachování AI výkonu |

| Chlazení a napájení | Optimalizováno pro energeticky náročné AI úlohy – obsahuje Dell Smart Cooling pro výkonné GPU jako H100 | Efektivní chlazení a řízení napájení – využívá Lenovo XClarity Controller k vyvážení spotřeby energie v AI aplikacích |

| Formát a hustota | 2U rackový server – vyšší hustota pro podnikové AI | 2U rackový server – navržen pro škálovatelnost a modulární AI expanzi |

| Hlavní použití | Podnikové AI a výkonné výpočty | Škálovatelná AI infrastruktura a nákladově efektivní AI nasazení |

Dell PowerEdge R750

Vysoce výkonný podnikový server navržený pro AI akceleraci, PowerEdge R750 podporuje až dvě GPU NVIDIA H100 PCIe. Díky PCIe Gen 4 linkám a vysokorychlostní síťové konektivitě poskytuje potřebný výkon pro trénink AI modelů, inferenci a datově náročné aplikace.

- Optimalizováno pro AI a strojové učení – podporuje konfigurace se dvěma GPU, což urychluje AI úlohy a real-time inferenci.

- Podniková úroveň výkonu – nabízí vysokou šířku pásma a efektivní řízení spotřeby energie, což z něj činí silnou volbu pro podniky zaměřené na AI.

Odemykejte výkon AI s PowerEdge PowerEdge R750

Lenovo ThinkSystem SR650 V2

Tento univerzální rackový server je navržen pro podniky, které potřebují škálovatelnost. Podporuje plnohodnotné, plné výšky a dvouširoké GPU včetně NVIDIA H100, což jej činí optimalizovaným pro AI úlohy vyžadující rychlé zpracování, hluboké učení a analýzu velkých dat.

- AI infrastruktura připravená na budoucnost – navržen pro škálovatelná AI nasazení, která zajišťují plynulou expanzi podle rostoucích požadavků.

- Nákladově efektivní výkon – repasovaný SR650 V2 umožňuje podnikům integrovat AI infrastrukturu s výrazně nižšími náklady a zpřístupnit tak výkonnou AI technologii.

Odemykejte výkon AI s PowerEdge SR650 V2

Potřebujete pomoc s výběrem správného AI serveru?

Výběr správného AI serveru nemusí být složitý. Ať už potřebujete repasované GPU NVIDIA A100 nebo H100, nebo odborné doporučení, jsme zde, abychom vám pomohli.

Jak vám můžeme pomoci:

✔ Personalizované poradenství ohledně AI serverů – pomůžeme vám najít nejlepší řešení pro váš trénink AI modelů nebo hluboké učení.

✔ Upozornění na dostupnost skladových zásob – dostávejte notifikace o nových zásobách repasovaných GPU A100 nebo H100 nebo objevte alternativní řešení.

Ušetřete až 70 % na AI infrastruktuře – bez kompromisu na výkonu

Potřebujete cenově dostupný trénink AI s GPU A100/V100 nebo vysoce výkonné GPU H100? Kontaktujte nás nyní pro odborné poradenství, ceny a dostupnost.